Anthropic, señaló, sigue manteniendo dos líneas rojas: no a la vigilancia masiva dentro del país (lo que implícitamente sugiere que la vigilancia masiva en el extranjero se considera aceptable) y no a las armas totalmente autónomas.

Amodei destacó que Anthropic fue la primera empresa de IA en desplegar sus modelos en redes gubernamentales clasificadas, laboratorios nacionales y para clientes del ámbito de la seguridad. Claude ya se utiliza ampliamente para análisis de inteligencia, simulaciones, planificación operativa y operaciones cibernéticas.

En cuanto a las armas autónomas, Amodei argumentó que los sistemas de IA actuales simplemente no son lo suficientemente fiables como para eliminar por completo a los humanos del proceso de toma de decisiones. Anthropic ofreció al Pentágono realizar investigaciones conjuntas para mejorar la fiabilidad, pero la propuesta fue rechazada.

Sobre la vigilancia interna, Amodei advirtió que la IA podría combinar de forma automática y a gran escala datos fragmentados e individualmente inofensivos para crear perfiles completos de cada ciudadano.

También señaló lo que describió como acciones contradictorias por parte del Pentágono: calificar a Anthropic como un riesgo para la cadena de suministro y, al mismo tiempo, tratarla como indispensable para la seguridad nacional en virtud de la Ley de Producción para la Defensa (DPA). Según Amodei, estas posiciones se excluyen mutuamente. A pesar de la presión, Anthropic no tiene intención de cambiar su postura. Si el Pentágono elimina a Anthropic de sus sistemas, la empresa afirma que facilitará una transición fluida hacia otro proveedor.

Anthropic también ha renunciado a varios cientos de millones de dólares en ingresos al cortar el acceso a Claude a empresas chinas con vínculos con el Partido Comunista Chino, y apoya activamente controles estrictos a la exportación de chips avanzados.

Aquí, Anthropic también actúa claramente en su propio interés: los controles a la exportación de chips debilitan a los competidores chinos, y permitir que empresas chinas utilicen Claude para desarrollar sus propios modelos perjudicaría el negocio de Anthropic a largo plazo. Renunciar a estos ingresos funciona, por tanto, también como una forma de autoprotección.

Las concesiones del Pentágono no son suficientes para Anthropic

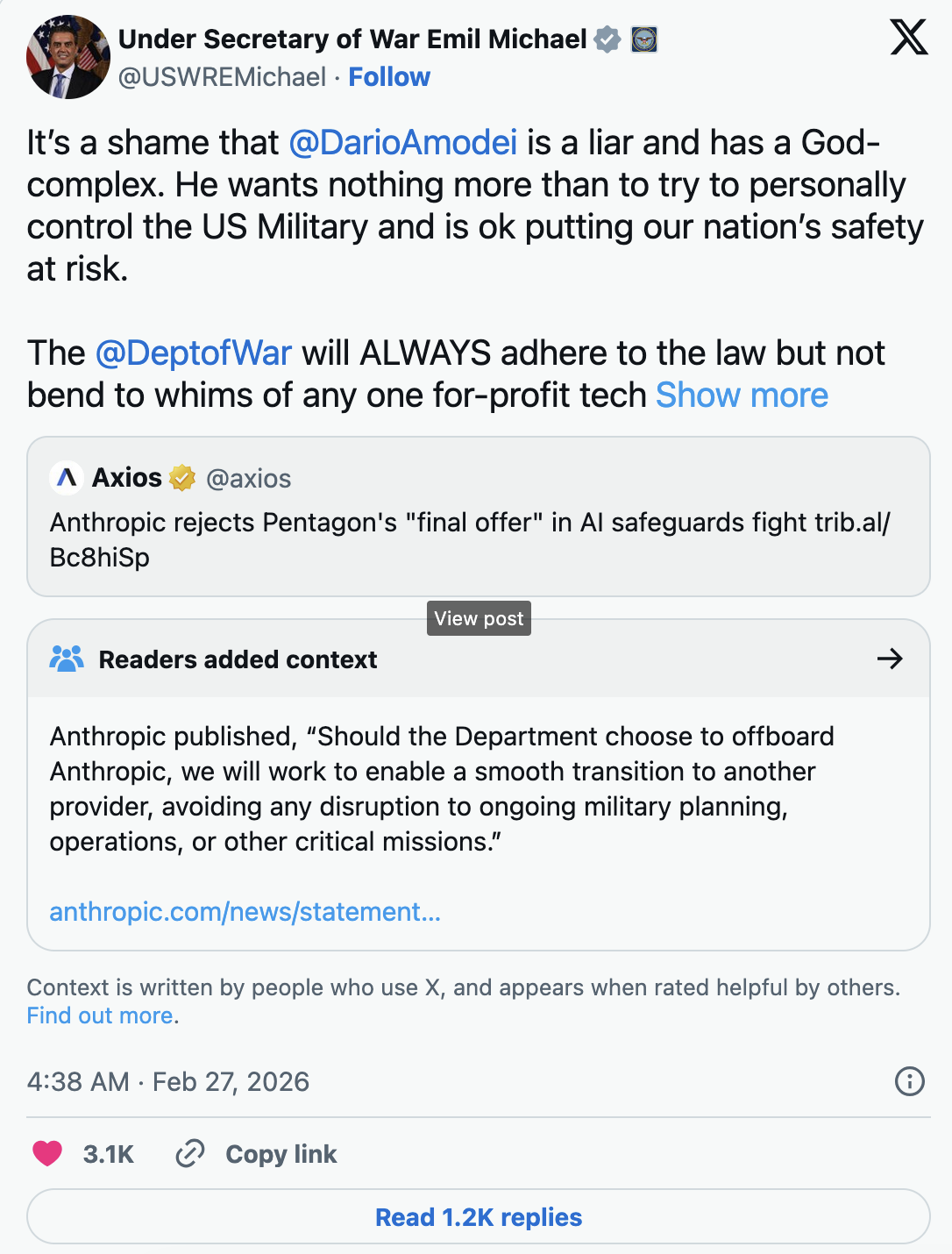

El director de tecnología del Pentágono, Emil Michael, declaró a CBS que el ejército había hecho “concesiones muy importantes”. Según él, el Pentágono ofreció reconocer por escrito las leyes existentes contra la vigilancia interna y las políticas vigentes del Pentágono sobre armas autónomas. También ofreció a Anthropic un asiento en el consejo de ética de IA del ejército.

Anthropic, sin embargo, consideró insuficientes estas concesiones. En respuesta, Michael calificó al CEO de Anthropic, Amodei, de “mentiroso” con un “complejo de dios” en X.

Cuando se le preguntó por qué el Pentágono no garantizaba explícitamente que los modelos de Anthropic no se utilizarían para vigilancia masiva ni para decisiones de armas totalmente autónomas, Michael respondió que eso ya está prohibido por la legislación vigente y por las políticas del Pentágono. “Hay que confiar en que el ejército haga lo correcto”, afirmó.

Al mismo tiempo, subrayó la necesidad de prepararse para el futuro y para el uso de la IA por parte de China: “Nunca daremos a una empresa una garantía por escrito de que no podemos defendernos”. El plazo para Anthropic vence el viernes a las 17:01.

¿Puede el Pentágono obligar a Anthropic a crear “WarClaude”?

El jurista Alan Z. Rozenshtein analizó en Lawfare qué puede exigir realmente el Pentágono en virtud de la Ley de Producción para la Defensa. La ley se remonta a la Guerra de Corea y otorga al presidente amplios poderes para obligar a las empresas a suministrar bienes en interés de la defensa nacional.

Según Rozenshtein, la valoración jurídica depende de qué exija exactamente el Pentágono. Se contemplan dos escenarios. En primer lugar, el Pentágono podría exigir que Anthropic suministre Claude sin restricciones contractuales de uso, es decir, el mismo modelo, pero sin las cláusulas que prohíben la vigilancia masiva y las armas autónomas. En ese caso, el gobierno tendría argumentos relativamente sólidos, ya que el producto en sí no cambiaría.

En segundo lugar, el Pentágono podría exigir que Anthropic reentrene completamente a Claude y elimine las salvaguardas del propio modelo. Esto sería mucho más difícil de imponer, sostiene Rozenshtein, ya que en la práctica constituiría un nuevo producto. No está claro jurídicamente si la DPA puede obligar a las empresas a crear productos que no ofrecen de otro modo.

Un reentrenamiento forzado también plantearía cuestiones relacionadas con la Primera Enmienda: si las decisiones de entrenamiento se consideran juicios editoriales, el Estado podría estar obligando a Anthropic a expresar valores que la empresa rechaza.

Rozenshtein subraya una contradicción fundamental: el Pentágono no puede clasificar simultáneamente a Anthropic como un riesgo para la seguridad y tratarla como indispensable para la defensa nacional en virtud de la DPA. Una negativa podría exponer a Anthropic a consecuencias penales. El camino más probable, sugiere, sería cumplir bajo protesta e impugnar de inmediato la orden ante los tribunales.

ES

ES  EN

EN