La aplicación necesaria, Google AI Edge Gallery, está disponible de forma gratuita para Android y iOS. Tras el lanzamiento de Gemma 4, ascendió al puesto número 4 entre las aplicaciones gratuitas de productividad más descargadas en la App Store de iOS, justo detrás de Claude, Gemini y ChatGPT.

Gemma 4 se basa en la misma investigación que el modelo propietario Gemini 3 de Google, pero se distribuye bajo la licencia Apache 2.0, apta para uso comercial. Desde el lanzamiento de la primera generación, la familia Gemma ha sido descargada más de 400 millones de veces, según Google. Todos los modelos pueden procesar texto, imágenes y audio, y son compatibles con más de 140 idiomas.

Cuatro variantes para diferente hardware

Todos los modelos procesan texto, imágenes y audio y admiten más de 140 idiomas. En la versión más reciente hay cuatro variantes: E2B y E4B están optimizadas específicamente para smartphones. La “E” significa “effective parameters” (parámetros efectivos), es decir, la cantidad de parámetros que realmente están activos durante el cálculo. En formato cuantizado, el modelo E2B ocupa alrededor de 1,3 GB de almacenamiento en el dispositivo, mientras que el E4B utiliza unos 2,5 GB.

Las variantes más grandes, 26B y 31B, están dirigidas a servidores y equipos de alto rendimiento. La versión 26B utiliza una arquitectura Mixture-of-Experts con 128 expertos, lo que significa que solo 3,8 mil millones de parámetros están activos al mismo tiempo. El modelo denso 31B ofrece una ventana de contexto de hasta 256.000 tokens.

Google también optimizó las variantes para smartphones en colaboración con Arm y Qualcomm para los procesadores móviles actuales. Según Google, Gemma 4 en Android es hasta cuatro veces más rápido que la generación anterior y consume hasta un 60 % menos de batería. En sus propias pruebas, Arm informa de una velocidad de procesamiento de entradas 5,5 veces mayor de media, siempre que el dispositivo utilice un procesador Arm más reciente con el conjunto de instrucciones SME2, una extensión que acelera directamente en el chip los cálculos matriciales para modelos de IA.

Lo que la app puede hacer en un smartphone

Los requisitos son Android 12 o iOS 17. Las dos variantes para smartphones difieren en sus necesidades de memoria: el modelo más pequeño, E2B, ocupa solo alrededor de 1,3 GB en formato cuantizado y funciona en dispositivos con 6 GB de RAM, mientras que el modelo más grande, E4B, requiere unos 2,5 GB de almacenamiento para el modelo y al menos 8 GB de RAM.

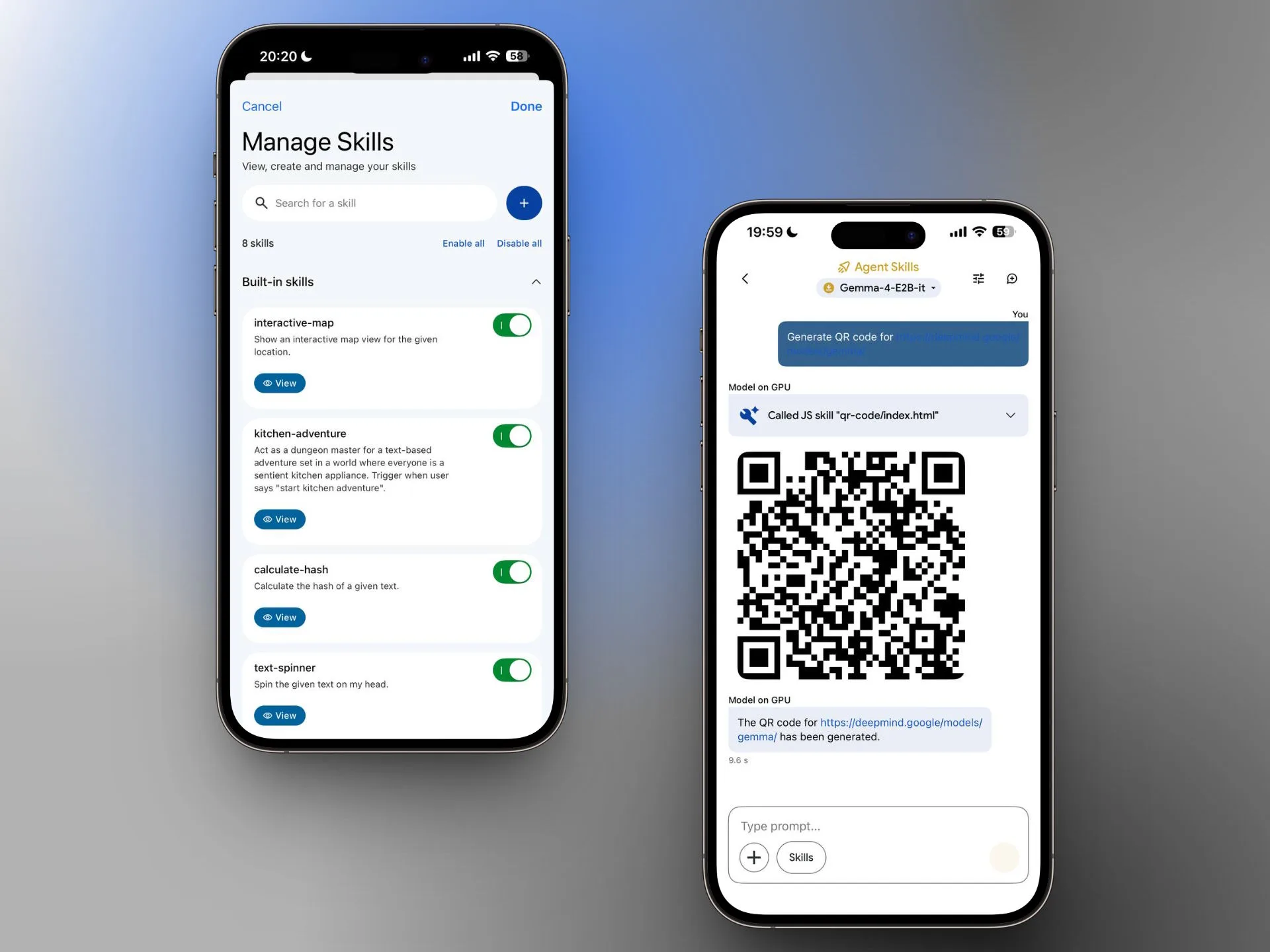

Dos capturas de pantalla de iPhone de la aplicación Google AI Edge Gallery muestran, a la izquierda, la pantalla de gestión de skills con opciones activables como interactive-map, kitchen-adventure, calculate-hash y text-spinner. A la derecha, un chat con el modelo Gemma 4 E2B muestra cómo genera un código QR mediante una Agent Skill.

Además de chat, reconocimiento de imágenes y transcripción de audio, la app ofrece las llamadas Agent Skills: búsqueda en Wikipedia, mapas interactivos, resúmenes generados automáticamente y tarjetas de estudio. Gemma 4 también puede describir fotos, convertir entradas de voz en gráficos y visualizaciones, e incluso trabajar junto con otros modelos locales, por ejemplo para texto a voz o generación de imágenes. Google lo demuestra con una skill de ejemplo que describe y reproduce sonidos de animales.

Según Google, el reconocimiento de imágenes también se beneficia de la nueva generación: las aplicaciones con OCR, es decir, el reconocimiento de texto en imágenes, gráficos o escritura a mano, ahora ofrecen resultados más precisos. También se ha mejorado la comprensión de expresiones temporales, lo que resulta relevante para calendarios, recordatorios y alarmas.

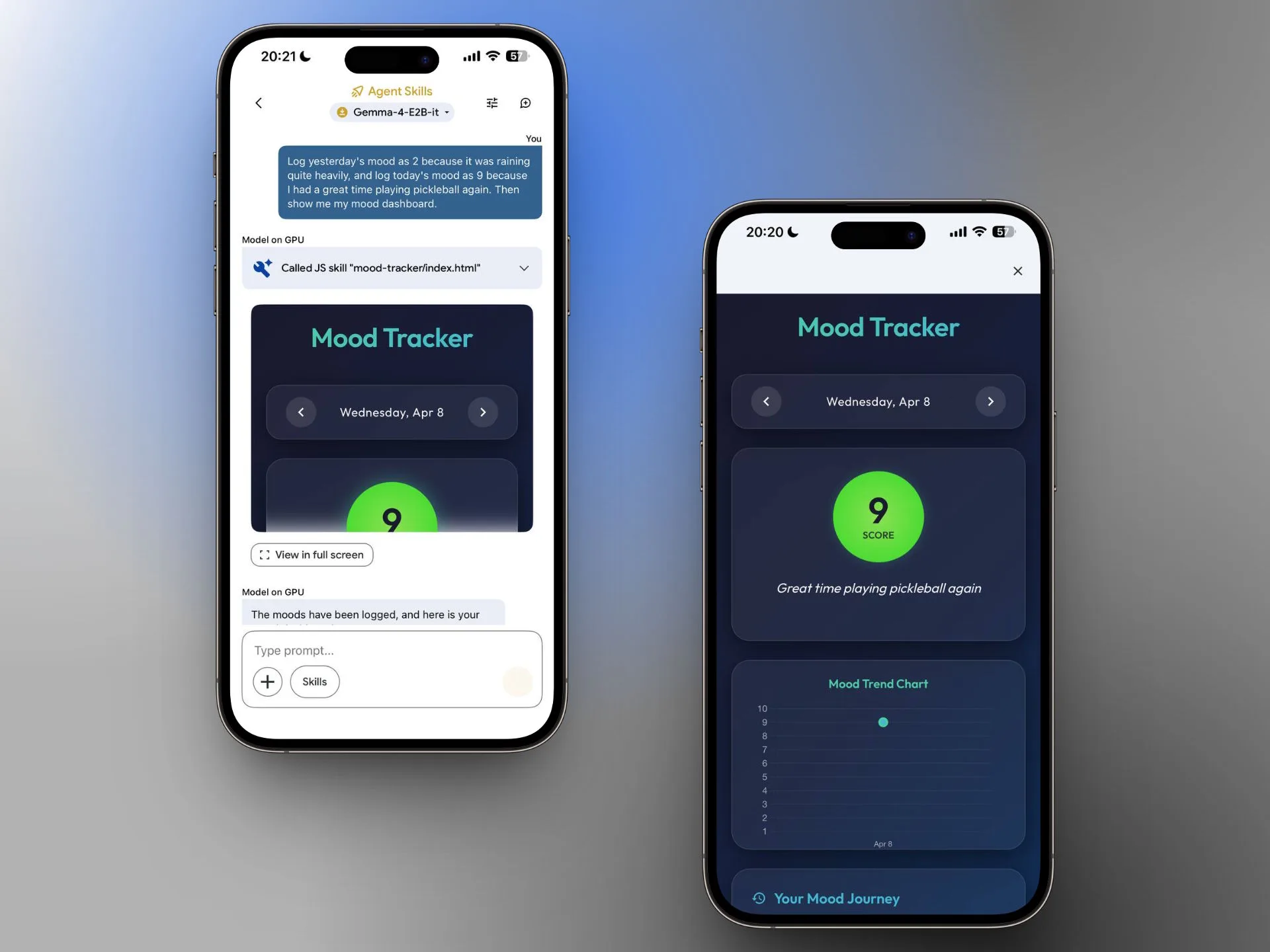

Otras dos capturas de pantalla de iPhone de la aplicación Google AI Edge Gallery muestran, a la izquierda, un chat con el modelo Gemma 4 E2B que activa la skill de JS “mood-tracker” en respuesta a una instrucción de texto y muestra un panel interactivo. A la derecha aparece la vista completa del Mood Tracker con una puntuación de 9, un gráfico de tendencia y la nota “Great time playing pickleball again”.

Por separado, estas funciones no son especialmente llamativas en comparación con los proveedores en la nube. Sin embargo, lo destacable es que una app de demostración que utiliza un modelo totalmente local en un smartphone ahora puede usar estas herramientas de forma independiente. Los desarrolladores también pueden crear sus propias skills a través de GitHub y compartirlas con la comunidad. Aunque las herramientas integradas requieren conexión a internet, el modelo en sí sigue ejecutándose localmente. Los chats no se almacenan.

Base para la próxima generación de Gemini Nano

Según Google, Gemma 4 E2B y E4B forman la base de Gemini Nano 4, la próxima generación del modelo on-device de Android a nivel de sistema. Se espera que el código escrito hoy para Gemma 4 sea automáticamente compatible con Gemini Nano 4 cuando llegue más adelante este año a nuevos dispositivos insignia. Gemini Nano ya funciona en más de 140 millones de dispositivos Android, donde se utiliza para funciones como Smart Replies y resúmenes de audio.

Con FunctionGemma, Google ya había mostrado en diciembre cómo un pequeño modelo local con solo 270 millones de parámetros puede pasar comandos a otras aplicaciones en un smartphone. El modelo traduce el lenguaje natural en llamadas de función estructuradas y puede, por ejemplo, encender y apagar la linterna, crear un nuevo contacto, enviar correos electrónicos, crear entradas de calendario, mostrar ubicaciones en el mapa o abrir la configuración de Wi-Fi.

La importancia estratégica que han adquirido las capacidades de IA local en smartphones también se refleja en el acuerdo multimillonario entre Apple y Google: desde enero, se ha confirmado que la próxima generación de los Foundation Models de Apple se basará en la tecnología Gemini de Google y se espera que impulse una importante actualización de Siri más adelante este año.

Gemma 4 representa un gran paso adelante para la IA en el dispositivo, al demostrar que los smartphones ya pueden ejecutar modelos multimodales de forma local mientras acceden a herramientas útiles mediante skills modulares. Su verdadera importancia no radica solo en el rendimiento, sino también en cómo podría acelerar una transición más amplia desde asistentes dependientes de la nube hacia ecosistemas de IA móvil más privados, ágiles y responsivos.

ES

ES  EN

EN